Seedance 2.0 人工智慧影片產生器

使用 Seedance 2.0 創建令人驚嘆的視頻,這是一個支援多模式輸入和精確參考的專業視頻生成模型。透過影像、視訊、音訊、文字的深度融合,實現可控制的視覺擴展、動作複製、視聽同步。

Seedance 2.0 AI影片產生器的影片範例

透過上傳肖像和舞蹈參考視頻,該模型可以產生具有精確運動一致性和自然相機過渡的動態剪輯。

Seedance 2.0 AI視訊模型核心特性

此AI視訊模型建立在「可引用、可編輯、可擴展」的概念之上,專注於多模態融合和複雜視覺元素的穩定控制。

多模態輸入集成

系統同時處理影像、視訊、音訊素材,結合文字指令統一生成。不同的媒體類型在同一工作流程中進行解析和重組,以建立複雜的敘事結構或多維視覺組合,顯著增強創意靈活性。

統一處理

結構重組

創意彈性

精確參考和複製

使用者可以在參考材料中指定個人特徵、運動路徑或影片語言。該模型能夠理解並在新影片中複製這些元素,使其成為運動轉移、特定姿勢模仿或模仿複雜攝影機軌蹟的理想選擇。

特徵提取

動作轉移

精確複製

一致性控制

在多鏡頭生成或擴展過程中,模型會鎖定臉部細節、服裝紋理和環境風格。透過減少視覺漂移,它可確保長序列保持穩定且邏輯連貫,並滿足視覺嚴謹性的專業標準。

視覺錨定

邏輯連貫性

減少漂移

Seedance 2.0 AI視訊模型的優勢

透過簡化操作路徑和整合工作流程,該模型允許創建者專注於概念意圖而不是技術複雜性。

自然語言驅動

複雜的任務是透過描述創意目標來完成的,例如指定特定資產作為開場框架或引用特定節奏。這種互動消除了繁瑣的配置的需要,降低了從靈感到最終視覺產品的障礙。

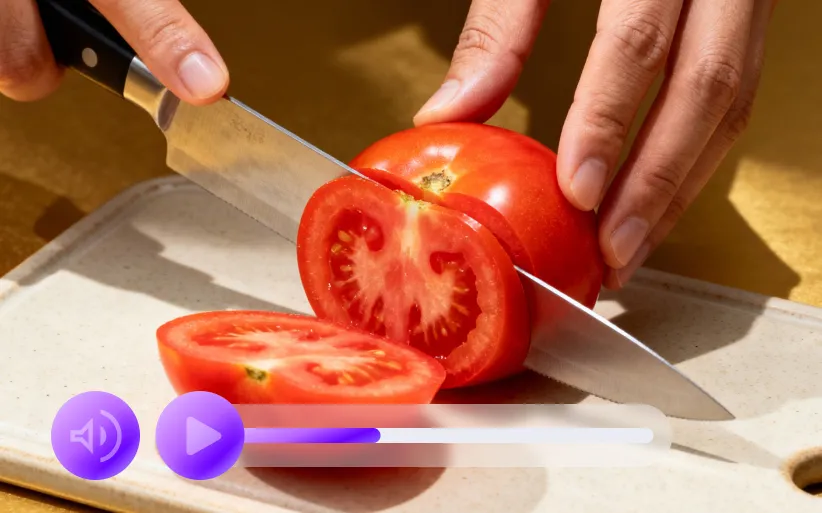

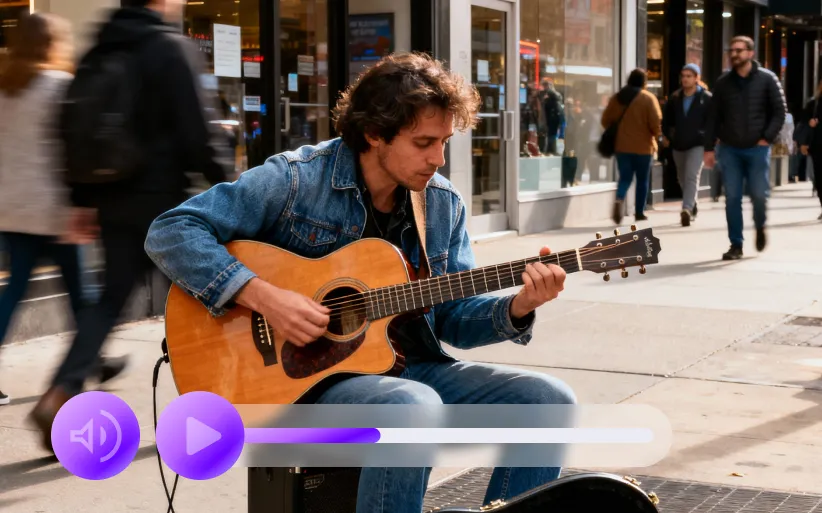

視聽同步

內建音訊分析和節奏匹配機制,根據背景音樂自動調整視覺運動頻率。該系統還可以產生匹配的環境聲音,從多感官的角度增強沉浸感和真實感。

迭代效率

可以直接擴展或微調結果,而無需從頭開始。這種非線性編輯邏輯非常適合需要重複最佳化腳本或鏡頭結構的工作流程,顯著提高輸出速度。

跨場景適配

從行銷材料到高端電影預先視覺化,該模型在統一框架內支援多種創作類型。這種通用能力有效降低了不同工具之間的切換成本,並增強了生產穩定性。

Seedance 2.0 AI影片產生器應用程式場景

憑藉其精確控制和多模態集成,該工具廣泛應用於專業成像和行銷領域。

廣告和品牌內容

透過參考現有品牌風格產生新的產品展示。這使得團隊能夠保持視覺識別,同時快速測試各種創意方向並提高反應速度。

教育和教學影片製作

將靜態教學圖像與配音結合,產生視覺化教學片段。動態演示透過直覺的視覺回饋幫助闡明複雜的理論,使觀眾更容易掌握。

舞蹈與動作創作

將專業的運動參考應用於不同的數位角色或虛擬場景。這為虛擬角色的舞蹈教學、動作設計和表演提供了技術支援。

Seedance 2.0 AI影片產生器使用步驟

1. 步驟1

上傳圖片、影片、音訊等基礎資料,整理出可供參考的具體元素。

2. 步驟2

用自然語言描述創意目標,註明要引用的特定材料或視覺效果。

3. 步驟3

產生初始影片並執行進一步擴展或有針對性的局部修改以細化整體結構。