Seedance 2.0 人工智能视频生成器

使用 Seedance 2.0 创建令人惊叹的视频,这是一种支持多模式输入和精确参考的专业视频生成模型。通过图像、视频、音频、文本的深度融合,实现可控的视觉扩展、动作复制、视听同步。

Seedance 2.0 AI视频生成器的视频示例

通过上传肖像和舞蹈参考视频,该模型可以生成具有精确运动一致性和自然相机过渡的动态剪辑。

Seedance 2.0 AI视频模型核心特性

该AI视频模型建立在“可引用、可编辑、可扩展”的理念之上,专注于多模态融合和复杂视觉元素的稳定控制。

多模态输入集成

系统同时处理图像、视频、音频素材,结合文字指令统一生成。不同的媒体类型在同一工作流程中进行解析和重组,以构建复杂的叙事结构或多维视觉组合,显着增强创意灵活性。

统一处理

结构重组

创意灵活性

精确参考和复制

用户可以在参考材料中指定个人特征、运动路径或电影语言。该模型能够理解并在新视频中复制这些元素,使其成为运动转移、特定姿势模仿或模仿复杂摄像机轨迹的理想选择。

特征提取

动作转移

精确复制

一致性控制

在多镜头生成或扩展过程中,模型会锁定面部细节、服装纹理和环境风格。通过减少视觉漂移,它可确保长序列保持稳定且逻辑连贯,满足视觉严谨性的专业标准。

视觉锚定

逻辑连贯性

减少漂移

Seedance 2.0 AI视频模型的优势

通过简化操作路径和集成工作流程,该模型允许创建者专注于概念意图而不是技术复杂性。

自然语言驱动

复杂的任务是通过描述创意目标来完成的,例如指定特定资产作为开场框架或引用特定节奏。这种交互消除了繁琐的配置的需要,降低了从灵感到最终视觉产品的障碍。

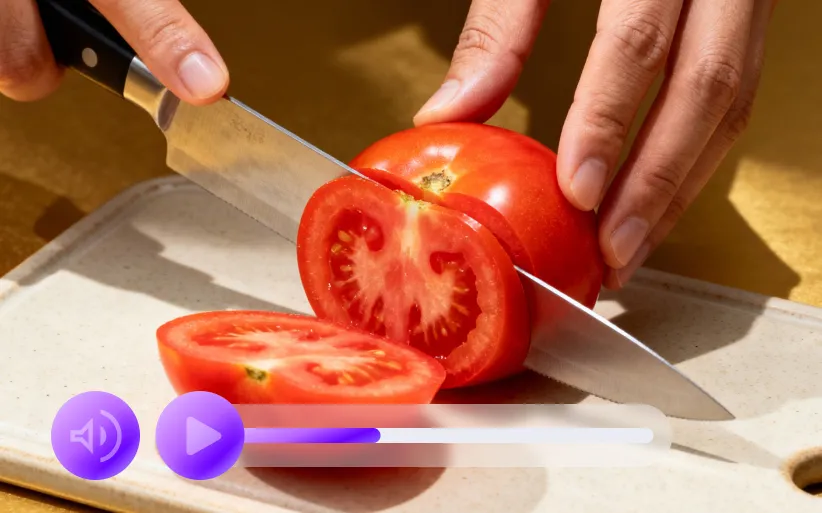

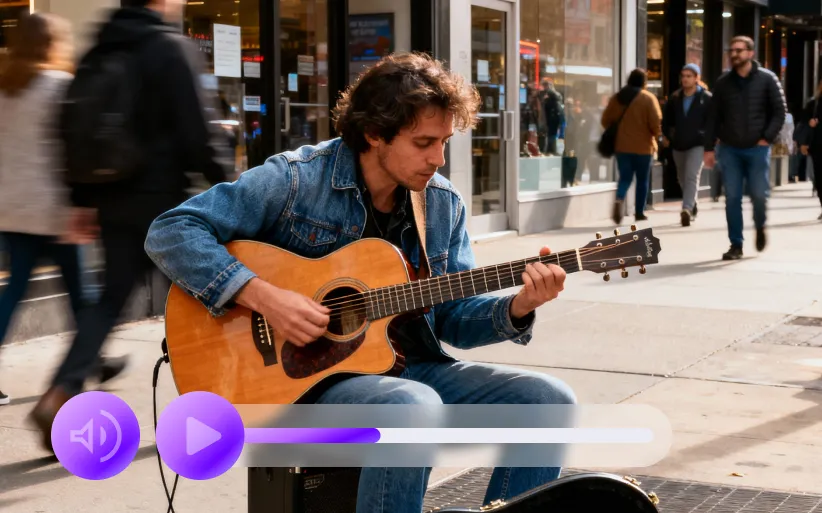

视听同步

内置音频分析和节奏匹配机制,根据背景音乐自动调整视觉运动频率。该系统还可以生成匹配的环境声音,从多感官的角度增强沉浸感和真实感。

迭代效率

可以直接扩展或微调结果,而无需从头开始。这种非线性编辑逻辑非常适合需要重复优化脚本或镜头结构的工作流程,显着提高输出速度。

跨场景适配

从营销材料到高端电影预可视化,该模型在统一框架内支持多种创作类型。这种通用能力有效降低了不同工具之间的切换成本,增强了生产稳定性。

Seedance 2.0 AI视频生成器应用场景

凭借其精确控制和多模态集成,该工具广泛应用于专业成像和营销领域。

广告和品牌内容

通过参考现有品牌风格生成新的产品展示。这使得团队能够保持视觉识别,同时快速测试各种创意方向并提高响应速度。

教育和教学视频制作

将静态教学图像与配音相结合,生成可视化教学片段。动态演示通过直观的视觉反馈帮助阐明复杂的理论,使观众更容易掌握。

舞蹈与动作创作

将专业的运动参考应用于不同的数字角色或虚拟场景。这为虚拟角色的舞蹈教学、动作设计和表演提供了技术支持。

Seedance 2.0 AI视频生成器使用步骤

1. 步骤1

上传图片、视频、音频等基础材料,整理出可供参考的具体元素。

2. 步骤2

用自然语言描述创意目标,注明要引用的特定材料或视觉效果。

3. 步骤3

生成初始视频并执行进一步扩展或有针对性的局部修改以细化整体结构。