Generatore video AI Seedance 2.0

Crea video straordinari con Seedance 2.0, un modello di generazione video professionale che supporta input multimodale e riferimenti precisi. Integrando profondamente immagini, video, audio e testo, consente l'espansione visiva controllabile, la replica del movimento e la sincronizzazione audiovisiva.

Esempi video del generatore video AI Seedance 2.0

Caricando un ritratto e un video di riferimento sulla danza, la modella genera clip dinamiche con una precisa coerenza del movimento e transizioni naturali della telecamera.

Modello video AI di Seedance 2.0

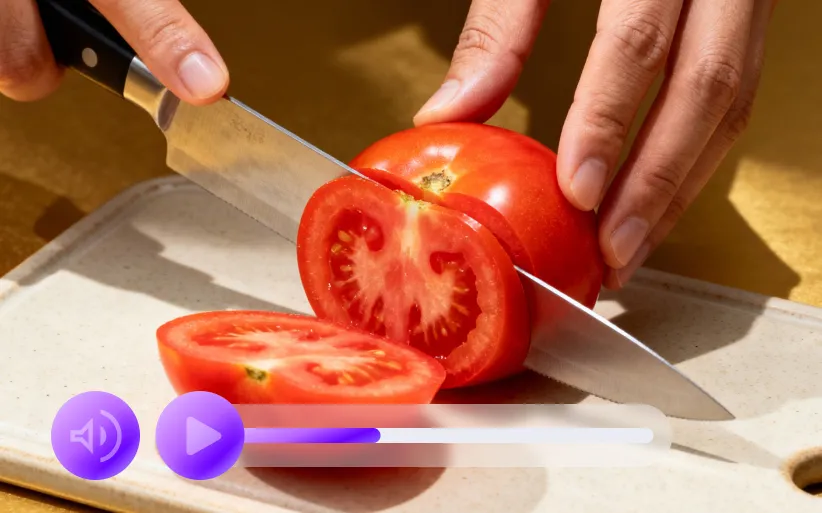

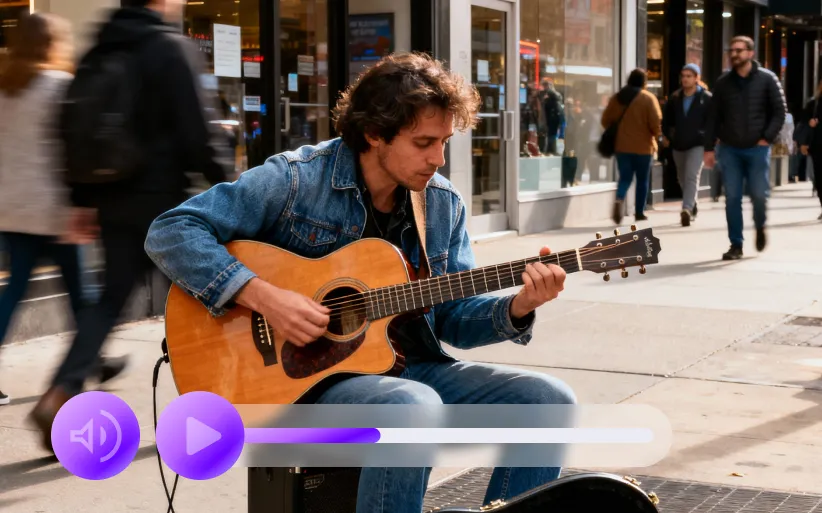

Nelle attività che combinano foto statiche di prodotti con musica di sottofondo specifica, produce materiali promozionali con ritmi audiovisivi altamente sincronizzati. Per le clip esistenti, il modello raggiunge connessioni perfette nell'illuminazione, nelle caratteristiche dei personaggi e nell'atmosfera ambientale.

Controlla di piùCaratteristiche principali del modello video AI di Seedance 2.0

Costruito sulla filosofia di essere "riferibile, modificabile ed estendibile", questo modello video AI si concentra sulla fusione multimodale e sul controllo stabile di elementi visivi complessi.

Integrazione di input multimodali

Il sistema gestisce simultaneamente immagini, video e materiali audio, combinati con istruzioni di testo per la generazione unificata. Diversi tipi di media vengono analizzati e riorganizzati all'interno dello stesso flusso di lavoro per costruire strutture narrative complesse o combinazioni visive multidimensionali, migliorando significativamente la flessibilità creativa.

Elaborazione unificata

Riorganizzazione strutturale

Flessibilità creativa

Riferimento preciso e replica

Gli utenti possono specificare tratti individuali, percorsi di movimento o linguaggi cinematografici all'interno del materiale di riferimento. Il modello comprende e replica questi elementi nei nuovi video, rendendolo ideale per il trasferimento del movimento, l'imitazione di pose specifiche o l'imitazione di traiettorie complesse della fotocamera.

Estrazione di caratteristiche

Trasferimento del movimento

Duplicazione precisa

Controllo della coerenza

Durante la generazione o l'espansione di più scatti, il modello blocca i dettagli del viso, le trame dei vestiti e gli stili ambientali. Riducendo la deriva visiva, garantisce che le sequenze lunghe rimangano stabili e logicamente coerenti, soddisfacendo gli standard professionali di rigore visivo.

Ancoraggio visivo

Coerenza logica

Riduzione della deriva

Vantaggi del modello video AI Seedance 2.0

Semplificando i percorsi operativi e integrando i flussi di lavoro, il modello consente ai creatori di concentrarsi sull'intento concettuale piuttosto che sulle complessità tecniche.

Guidato dal linguaggio naturale

Le attività complesse vengono completate descrivendo obiettivi creativi, come designare una risorsa specifica come fotogramma di apertura o fare riferimento a un ritmo specifico. Questa interazione elimina la necessità di noiose configurazioni, abbassando la barriera dall'ispirazione al prodotto visivo finale.

Sincronizzazione audiovisiva

I meccanismi integrati di analisi audio e abbinamento del ritmo regolano automaticamente la frequenza del movimento visivo in base alla musica di sottofondo. Il sistema può anche generare suoni ambientali corrispondenti per migliorare l'immersione e il realismo da una prospettiva multisensoriale.

Efficienza iterativa

I risultati possono essere estesi o perfezionati direttamente senza partire da zero. Questa logica di editing non lineare è perfetta per i flussi di lavoro che richiedono ripetute ottimizzazioni di script o strutture delle riprese, aumentando significativamente la velocità di output.

Adattamento a più scenari

Dai materiali di marketing alla pre-visualizzazione cinematografica di fascia alta, il modello supporta diversi tipi di creazione all'interno di un quadro unificato. Questa capacità universale riduce efficacemente il costo del passaggio tra diversi strumenti e migliora la stabilità della produzione.

Scenari applicativi del generatore video AI Seedance 2.0

Grazie al controllo preciso e all'integrazione multimodale, lo strumento è ampiamente applicato nei settori dell'imaging professionale e del marketing.

Pubblicità e contenuto del marchio

Genera nuove visualizzazioni di prodotti facendo riferimento agli stili di marchio esistenti. Ciò consente ai team di mantenere l'identità visiva testando rapidamente varie direzioni creative e aumentando la velocità di risposta.

Produzione di video didattici e didattici

Combina immagini didattiche statiche con voci fuori campo per generare segmenti didattici visualizzati. Le dimostrazioni dinamiche aiutano a chiarire teorie complesse attraverso un feedback visivo intuitivo che è più facile da comprendere per il pubblico.

Danza e creazione di movimento

Applica riferimenti di movimento professionali a diversi personaggi digitali o scene virtuali. Ciò fornisce supporto tecnico per lezioni di danza, motion design e performance per avatar virtuali.

Passaggi di utilizzo del generatore video AI Seedance 2.0

1. Passaggio 1

Carica materiali di base come immagini, video o audio e organizza gli elementi specifici destinati a riferimento.

2. Passaggio 2

Descrivere gli obiettivi creativi in linguaggio naturale, annotando materiali specifici o effetti visivi a cui fare riferimento.

3. Passaggio 3

Genera il video iniziale ed esegui ulteriori espansioni o modifiche locali mirate per affinare la struttura complessiva.