Seedance 2.0 AI-Videogenerator

Erstellen Sie atemberaubende Videos mit Seedance 2.0, einem professionellen Videogenerierungsmodell, das multimodale Eingaben und präzise Referenzierung unterstützt. Durch die tiefe Integration von Bildern, Videos, Audio und Text ermöglicht es eine kontrollierbare visuelle Erweiterung, Bewegungsreplikation und audiovisuelle Synchronisierung.

Videobeispiele des Seedance 2.0 AI-Videogenerators

Durch das Hochladen eines Porträts und eines Tanzreferenzvideos generiert das Model dynamische Clips mit präziser Bewegungskonsistenz und natürlichen Kameraübergängen.

Seedance 2.0 AI-Videomodell

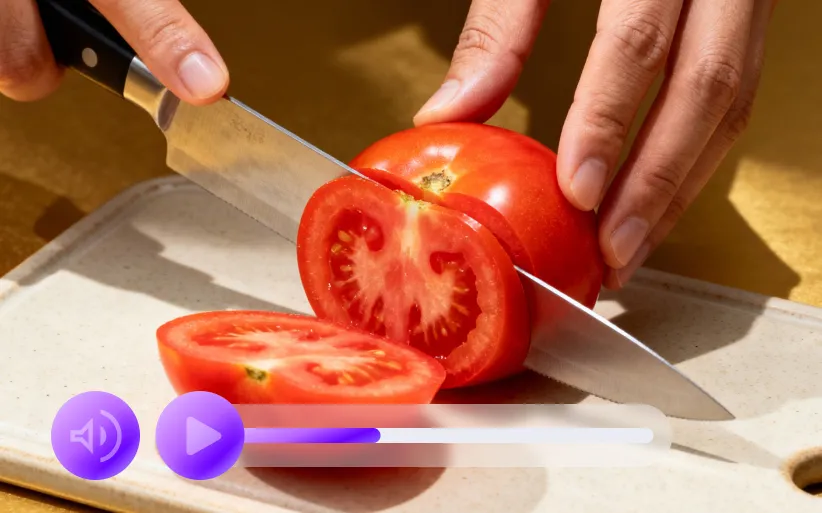

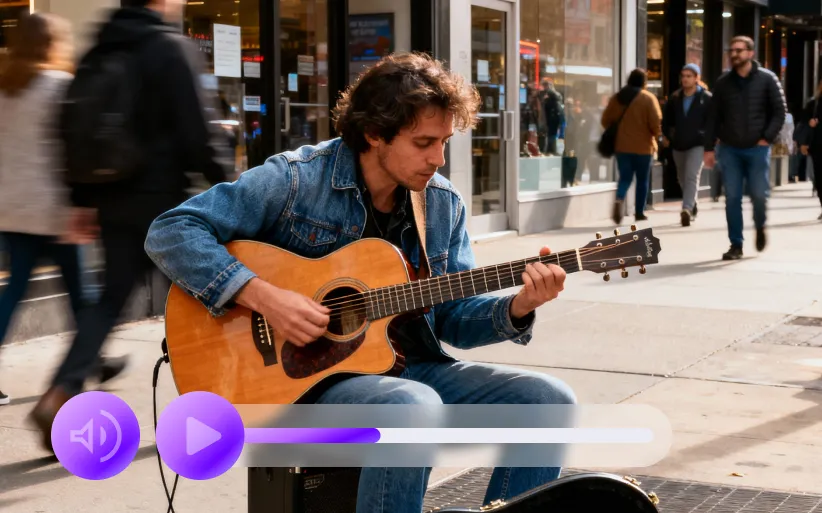

In Aufgabenstellungen, die statische Produktfotos mit spezifischer Hintergrundmusik kombinieren, entstehen Werbematerialien mit hochsynchronisierten audiovisuellen Rhythmen. Für vorhandene Clips erreicht das Modell nahtlose Verbindungen in Bezug auf Beleuchtung, Charaktermerkmale und Umgebungsatmosphäre.

Weitere Informationen finden Sie hierKernfunktionen des Seedance 2.0 AI-Videomodells

Dieses KI-Videomodell basiert auf der Philosophie „referenzierbar, bearbeitbar und erweiterbar“ und konzentriert sich auf die multimodale Fusion und die stabile Steuerung komplexer visueller Elemente.

Multimodale Eingabeintegration

Das System verarbeitet Bilder, Videos und Audiomaterialien gleichzeitig und kombiniert sie mit Textanweisungen für eine einheitliche Generierung. Verschiedene Medientypen werden innerhalb desselben Workflows analysiert und neu organisiert, um komplexe Erzählstrukturen oder mehrdimensionale visuelle Kombinationen zu erstellen, was die kreative Flexibilität erheblich erhöht.

Einheitliche Verarbeitung

Strukturelle Neuordnung

Kreative Flexibilität

Präzise Referenz und Replikation

Benutzer können innerhalb des Referenzmaterials einzelne Merkmale, Bewegungspfade oder Filmsprachen festlegen. Das Modell versteht diese Elemente und reproduziert sie in neuen Videos, wodurch es sich ideal für die Bewegungsübertragung, die Nachahmung spezifischer Posen oder die Nachahmung komplexer Kamerabahnen eignet.

Merkmalsextraktion

Bewegungsübertragung

Präzise Vervielfältigung

Konsistenzkontrolle

Während der Generierung oder Erweiterung mehrerer Aufnahmen speichert das Modell Gesichtsdetails, Kleidungstexturen und Umgebungsstile. Durch die Reduzierung der visuellen Drift wird sichergestellt, dass lange Sequenzen stabil und logisch kohärent bleiben und professionelle Standards für visuelle Genauigkeit erfüllen.

Visuelle Verankerung

Logische Kohärenz

Driftreduzierung

Vorteile des AI-Videomodells Seedance 2.0

Durch die Vereinfachung betrieblicher Pfade und die Integration von Arbeitsabläufen ermöglicht das Modell den Entwicklern, sich auf die konzeptionelle Absicht statt auf technische Komplexität zu konzentrieren.

Auf natürlicher Sprache basierend

Komplexe Aufgaben werden durch die Beschreibung kreativer Ziele erledigt, beispielsweise durch die Festlegung eines bestimmten Assets als Eröffnungsrahmen oder die Bezugnahme auf einen bestimmten Rhythmus. Diese Interaktion macht eine mühsame Konfiguration überflüssig und senkt die Hürde von der Inspiration bis zum endgültigen visuellen Produkt.

Audiovisuelle Synchronisation

Integrierte Audioanalyse- und Rhythmusanpassungsmechanismen passen die visuelle Bewegungsfrequenz basierend auf der Hintergrundmusik automatisch an. Das System kann außerdem passende Umgebungsgeräusche erzeugen, um das Eintauchen und den Realismus aus einer multisensorischen Perspektive zu verbessern.

Iterative Effizienz

Ergebnisse können direkt erweitert oder verfeinert werden, ohne bei Null anfangen zu müssen. Diese nichtlineare Bearbeitungslogik eignet sich perfekt für Arbeitsabläufe, die eine wiederholte Optimierung von Drehbüchern oder Aufnahmestrukturen erfordern, und steigert die Ausgabegeschwindigkeit erheblich.

Szenarioübergreifende Anpassung

Von Marketingmaterialien bis hin zu hochwertiger filmischer Vorvisualisierung unterstützt das Modell verschiedene Erstellungsarten innerhalb eines einheitlichen Rahmens. Diese universelle Fähigkeit reduziert effektiv die Kosten für den Wechsel zwischen verschiedenen Werkzeugen und erhöht die Produktionsstabilität.

Anwendungsszenarien des Seedance 2.0 AI Video Generators

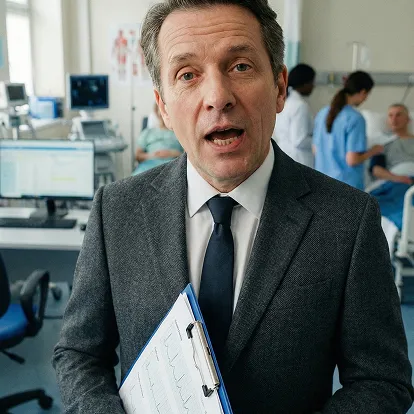

Dank seiner präzisen Steuerung und multimodalen Integration findet das Tool breite Anwendung in den Bereichen professionelle Bildbearbeitung und Marketing.

Werbung und Markeninhalte

Generieren Sie neue Produktpräsentationen, indem Sie auf bestehende Markenstile verweisen. Dies ermöglicht es Teams, ihre visuelle Identität beizubehalten, gleichzeitig verschiedene kreative Richtungen schnell zu testen und die Reaktionsgeschwindigkeit zu erhöhen.

Produktion von Bildungs- und Lehrvideos

Kombinieren Sie statische Lehrbilder mit Voiceovers, um visualisierte Lehrsegmente zu erstellen. Dynamische Demonstrationen helfen dabei, komplexe Theorien durch intuitives visuelles Feedback zu verdeutlichen, das für das Publikum leichter zu verstehen ist.

Tanz- und Bewegungskreation

Wenden Sie professionelle Bewegungsreferenzen auf verschiedene digitale Charaktere oder virtuelle Szenen an. Dies bietet technische Unterstützung für Tanzunterricht, Bewegungsdesign und Performances für virtuelle Avatare.

Verwendungsschritte des Seedance 2.0 AI Video Generators

1. Schritt 1

Laden Sie Basismaterialien wie Bilder, Videos oder Audio hoch und organisieren Sie die spezifischen Elemente, die als Referenz dienen sollen.

2. Schritt 2

Beschreiben Sie kreative Ziele in natürlicher Sprache und notieren Sie dabei bestimmte Materialien oder visuelle Effekte, auf die Bezug genommen werden soll.

3. Schritt 3

Erstellen Sie das Ausgangsvideo und führen Sie weitere Erweiterungen oder gezielte lokale Modifikationen durch, um die Gesamtstruktur zu verfeinern.